Wowza 推出 AI 串流新架構!VIF 如何把影片變成即時數據?(2026 NAB Show 重點解析)

在即時串流(Live Streaming)與影像監控快速成長的今天,企業面臨一個共同問題:影片量爆炸,但無法有效利用。

無論是體育直播、智慧監控,還是工業攝影機,影片往往只是「被觀看」,卻沒有被真正「理解」。

Wowza 在 2026 NAB Show 最新發佈新推出的 Video Intelligence Framework(VIF),正是為了解決這個問題——

👉 將影片從「媒體內容」轉變為「可即時分析與觸發行動的數據來源」。

本文將帶你深入解析 VIF 的技術架構、運作原理與實際應用場景,幫助你理解 AI 如何真正改變串流產業。

什麼是 Video Intelligence Framework (VIF)?

Video Intelligence Framework(VIF) 是一種將 AI 推論能力直接嵌入串流流程(Streaming Workflow)的架構設計。

簡單來說,它做到三件關鍵事情:

1、🎥 將影片「即時拆解」為可分析的影像幀

2、🧠 透過 AI 模型進行即時辨識(物件、事件、行為)

3、📊 將結果轉換為「系統可用的資料」(例如 JSON、事件訊號)

這代表:

👉 影片不再只是觀看用,而是可以被搜尋、觸發與自動化處理的資料流

這種轉變,讓企業可以從被動觀看,進化為主動決策。

VIF 技術架構與運作原理

VIF 的核心價值,在於其模組化與高擴展性的設計。

1. AI 推論與串流分層(Layer Separation)

📌 串流層(Streaming Layer):負責傳輸(RTMP / HLS / WebRTC)

📌 AI 層(Inference Layer):負責影像分析與模型運算

👉 優點:

✅ AI 高運算負載不影響串流穩定性

✅ 可獨立擴展 GPU / CPU 資源

2. Stream-to-Signal 即時轉換流程

整體流程如下:

1、Frame Extraction(幀提取)

從直播流中定時抽取影像畫面

2、AI Inference(AI 推論)

將畫面送入 AI 模型分析

3、Structured Output(結構化輸出)

轉換為可觸發系統的訊號:

📍JSON logs

📍Webhooks(事件觸發)

📍ID3 metadata(串流標籤)

📍時間戳短片(clip generation)

📍Overlay(即時畫面標記)

👉 本質上是:Video → Data → Action

3. BYOM(Bring Your Own Model)

VIF 支援企業導入自有 AI 模型,例如:

📍 工業瑕疵檢測模型

📍 軍事辨識模型

📍 醫療影像分析模型

👉 優勢:

✅ 不受限於通用 AI(如 generic object detection)

✅ 可建立高度差異化能力

4. 安全部署與硬體優化

VIF 特別強調企業級部署需求:

- 🔒 Air-Gapped(完全離線運行)

- 🏢 On-Premise(本地部署)

- ⚡ GPU 加速(NVIDIA / AMD Xilinx)

-💡 ARM64 優化(AWS Graviton)

👉 適用於:

✅ 國防

✅ 醫療

✅ 金融監控

關鍵應用場景解析

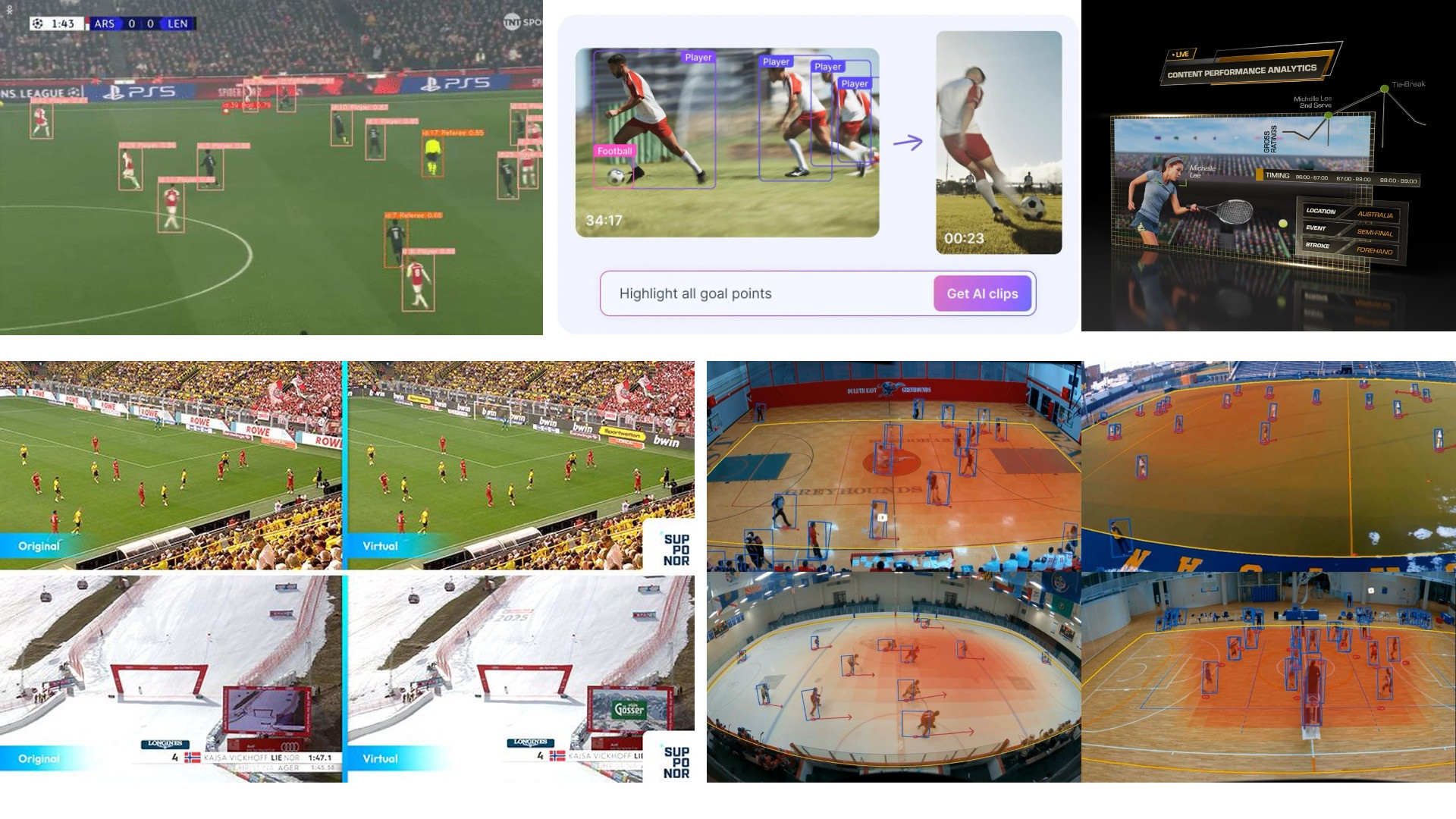

🎬 媒體與體育直播

AI 廣告插入(VGAI)

✅ 自動識別「精彩瞬間」插入廣告

✅ 提升 CPM(最高可 +40%)

✅ 自動精彩片段生成

✔️ 進球、犯規、自動剪輯

✔️ 即時發布到社群或 OTT 平台

🚓 公共安全與智慧監控

✅ 區域入侵偵測

✅ 逆向行駛 / 危險行為辨識

✅ 武器或異常物件偵測

👉 解決:人力無法監看大量攝影機的問題 ✨

同時結合:

✔️ C2PA

✔️ CMAF 簽名技術

確保影像不可竄改、可驗證

🏭 工業與營運監控

✅ 設備狀態監測(壓力表、閥門)

✅ 攝影機健康檢測(模糊 / 遮擋)

✅ 遠端低頻寬監控(衛星傳輸)

👉 重點價值:

✔️ 預防問題(而不是事後處理)

✔️ 降低維運成本

解決方案:如何透過 Wowza VIF 落地 AI 串流?

Wowza 的 VIF 不只是技術概念,而是一個可實際部署的解決方案。

它特別適合以下需求:

✅ 如果你正在面對:

📌 影片數據過多,無法分析

📌 需要即時事件觸發(alerts / automation)

📌 想提升直播變現能力

📌 有自有 AI 模型需要整合

👉 VIF 提供:

✔️ 完整 Stream → AI → Action pipeline

✔️ 與既有串流系統(HLS / WebRTC)整合

✔️ 支援企業級安全與私有部署

✔️ 可擴展 AI 運算架構

相比傳統串流平台:

👉 VIF 的核心差異是:

讓「影片本身」成為可運算資產,而不是單純內容載體

FAQ

Q1:VIF 和一般影片分析(Video Analytics)有何不同?

VIF 是「即時串流導向」,而非事後分析。它可在影片播放當下即時觸發事件。

Q2:是否一定要使用 Wowza 的 AI 模型?

不需要。VIF 支援 BYOM(Bring Your Own Model),可整合企業自有模型。

Q3:VIF 是否適合低延遲應用(如 WebRTC)?

是的,VIF 可與低延遲串流(WebRTC)整合,實現即時分析與反應。

Q4:資料是否需要上雲處理?

不一定。VIF 支援 On-Premise 與 Air-Gapped 部署,適合高資安需求場景。

Q5:VIF 可以用於非媒體產業嗎?

可以,包含製造業、能源、醫療與智慧城市皆是主要應用場景。